Los deepfake de voz, una nueva amenaza para la ciberseguridad

- Actualidad

Aunque de momento su impacto sobre la ciberseguridad es mínimo, ya ha habido algún caso sonado del uso de esta tecnología en estafas y Kaspersky considera que se seguirá refinando y será un riesgo habitual en el futuro.

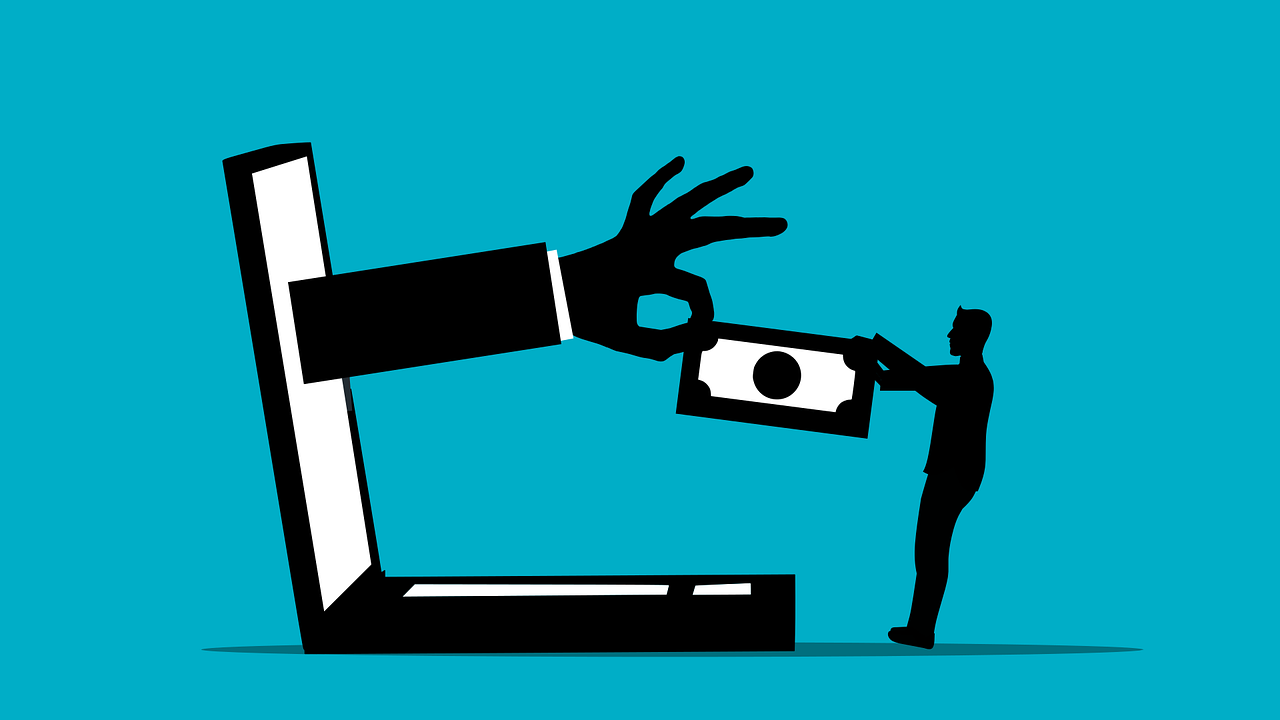

En octubre de este año, Tim Draper, fundador de fondos de capital riesgo y multimillonario, avisó en redes sociales que una versión deepfake de su voz se estaba utilizando para suplantarle y pedir el envío de criptomonedas. Hasta ahora, es el caso del deepfake de voz más notorio que ha habido, lo que lo hace de momento una amenaza casi anecdótica. Aunque es una área que apenas acaba de nacer.

Kaspersky recuerda que antes la creación de deepfakes requería de altos conocimientos de programación, mientras que ahora son mucho más accesibles. Además, la compañía considera que ya a corto plazo se verán modelos de simulación de voz más fáciles de utilizar y proporcionarán una calidad mucho mayor en sus resultados.

Sin obsesionarse demasiado por el tema, si un conocido nos hace a través de la voz una propuesta o exigencia económica que nos resulte extraña, Kaspersky indica que hay que estar atentos a detalles como la baja calidad del audio, si muestra ruidos o tiene un toque robótico. También recomienda realizar preguntas que se salgan del marco de la conversación para descolocar a los ciberatacantes.

Dmitry Anikin, científico de datos senior de Kaspersky, señala que “el principal consejo ahora mismo es no obsesionarse con este tipo de amenazas y estar continuamente buscando voces deepfakes donde no las hay. Es poco probable que con la tecnología actual se pueda crear una voz que no se pueda reconocer como artificial. Sin embargo, hay que ser conscientes de las amenazas que se ciernen y prepararse para el futuro. Los deepfake serán muy pronto una nueva realidad”.